百度飞桨联手南方电网 电力巡检迈向“无人时代(2)

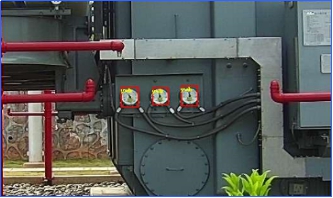

以变电设备巡视中的指针类表计检测和识读为例,在最开始的时候,他们使用传统的图像处理技术,用人工设计特征方法进行特征提取。这样的方法只能获取图像中目标对象的浅层特征,这使得识别过程极易受到光照等环境因素的影响,在各类干扰因素影响下,整体识别准确率并不高。

2017年,广东电网与百度建立了战略合作关系,赋能前端巡检设备也是合作的重要内容之一。智能巡检机器人攻关团队引入百度飞桨(PaddlePaddle)平台,利用其所提供的YOLO v3、U-Net,使机器人面向表计的深层次特征提取能力大大提高,突破了环境因素的制约,方法的准确率和鲁棒性显著提升,在表计目标检测、示数读取等方面的效果尤为显著。现在,对于用原有传统方法处理起来极为困难的表计目标,用深度学习方法已经可以获得处理效果的有效提升。

模型技术详解:YOLOv3与U-Net

YOLOv3是一个速度和精度均衡的目标检测网络,飞桨物体检测统一框架PaddleDetection通过增加mixup、label_smooth等处理,对YOLO v3进行了优化实现。YOLOv3也是一个单阶段的目标检测器。传统目标检测方法通过两阶段检测,第一阶段生成预选框,第二阶段对预选框进行分类得到类别,而YOLO将目标检测看作是对预测框位置的一个单阶段回归问题。因此,推理速度能够达到具有同样精度的两阶段目标检测方法的几乎2倍。此外,YOLOv3在最初版YOLO的基础上引入了多尺度预测,因而对小物体的检测精度大幅提高。

U-Net是飞桨语义分割库PaddleSeg中支持的四个主流分割网络之一,整个网络是标准的encoder-decoder网络,具有参数少、计算快、应用性强等特点,对场景有较高的适应度。U-Net使用跳跃连接,以拼接的方式将解码器和编码器中相同分辨率的feature map进行特征融合,帮助解码器更好地恢复目标的细节。

在变电站表计示数识读这一案例中,机器人对表计的读取需要经过表计整体目标检测及二次对准、表盘目标检测及示数读取两个阶段。原来的机器人主要是采用基于传统人工设计特征的图像处理方法实现表计的目标匹配和轮廓检测。由于这些方法只能实现浅层特征的提取,在应用的过程中容易受到图像背景、环境光照、拍摄角度等因素的影响,分类错误率较高。此外,样本量的增加对此类方法的作用也不大,大量深层特征无法被挖掘并用于提升算法的性能。

背景特征难区分

类似区域易误检

环境光线影响检测准确性

现场干扰(如水珠)

针对这些问题,对机器人的赋能升级采用了基于深度学习的方法,对涉及目标检测与图像分割的两个关键阶段进行了改善。出于降低图像处理的传输时延和资源需求、提高前端处理效率和智能化程度的目的,上述两个阶段均是在机器人本体上完成。因此,改进方案选择了更适用于前端推理实现的YOLOv3和U-Net模型。

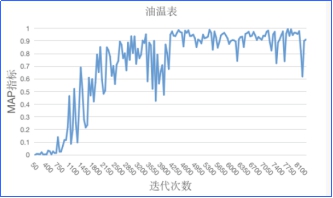

在面向表计目标检测的具体实现中,攻关团队所采用的训练集包含了946张图像样本,标注了2838个表计目标,而测试集则包含了236张图像样本。在基于飞桨YOLOv3的检测实现中,对表盘检测的最高mAP达到了0.9857,有效地提升了目标检测的查全率和查准率。

检测结果示例

mAP指标随迭代次数的变化图示